La entropía es un concepto que mide los cambios o propiedades de estado de un elemento desde su estado o momento inicial hasta el momento final. La entropía indica el grado de desorden de un sistema, y, por lo tanto, es la tendencia de pasar de un estado de orden a un estado de desorden (caos).

Cuando un sistema es sometido a un cambio, puede ser que el mismo nunca regrese a su estado original. Por ejemplo, si se produce un incendio forestal, habrá un elevado grado de entropía puesto que se precisará mucho tiempo y esfuerzo para que el sitio regrese al orden inicial anterior al incendio. Si se rompe un objeto como un plato de porcelana, el sistema es irreversible ya que no es posible que el mismo retorne a su estado anterior.

Estos son los problemas asociados con la Segunda Ley de la Termodinámica, también conocida como la Ley de la Entropía.

La Segunda Ley de la Termodinámica

La termodinámica es importante para diversas disciplinas científicas, desde la ingeniería hasta las ciencias naturales, pasando por la química, la física e incluso la economía. Un sistema termodinámico es un espacio confinado, que no deja entrar ni salir energía.

La Primera Ley de la Termodinámica tiene que ver con la conservación de la energía: probablemente recuerdes haber escuchado antes que la energía en un sistema cerrado permanece constante («la energía no se puede crear ni destruir»), a menos que sea manipulada desde el exterior. Sin embargo, la energía cambia constantemente de forma: un incendio puede convertir la energía química de una planta en energía térmica y electromagnética. Una batería convierte la energía química en energía eléctrica. El mundo gira y la energía se vuelve menos organizada.

La entropía es una medida del desorden en un sistema cerrado. De acuerdo con la Segunda Ley de la Termodinámica, la entropía en un sistema casi siempre aumenta con el tiempo: puede hacer el trabajo para crear orden en un sistema, pero incluso el trabajo que se reordena aumenta el desorden como un subproducto, generalmente en forma de calor. Debido a que la medida de la entropía se basa en las probabilidades, es posible, por supuesto, que la entropía disminuya en un sistema en ocasiones, pero eso es estadísticamente muy poco probable.

La definición de desorden

Es más difícil de lo que parece encontrar un sistema que no permita que la energía entre o salga; nuestro universo es tan buen ejemplo de uno como nosotros, pero la entropía describe cómo ocurre el desorden en un sistema tan grande como el universo o tan pequeño como un termo lleno de café.

Sin embargo, la entropía no tiene que ver con el tipo de desorden en el que piensas cuando encierras a un grupo de chimpancés en una cocina. Tiene más que ver con la cantidad de posibles permutaciones de desorden que se pueden hacer en esa cocina en lugar de con la magnitud del desorden. Por supuesto, la entropía depende de muchos factores: cuántos chimpancés hay, cuántas cosas se almacenan en la cocina y cómo de grande es la cocina. Entonces, si tuvieras que mirar dos cocinas, una muy grande y con mucha decoración y menaje, pero meticulosamente limpia, y otra que es más pequeña con menos cosas, pero ya bastante destrozada por los chimpancés, es tentador decir que la habitación más desordenada tiene más entropía, pero ese no es necesariamente el caso. La entropía se preocupa más por cuántos estados diferentes son posibles que por lo desordenada que está en este momento; un sistema, por lo tanto, tiene más entropía si contiene más moléculas y átomos y si es más grande o hay más chimpancés.

La entropía es confusa

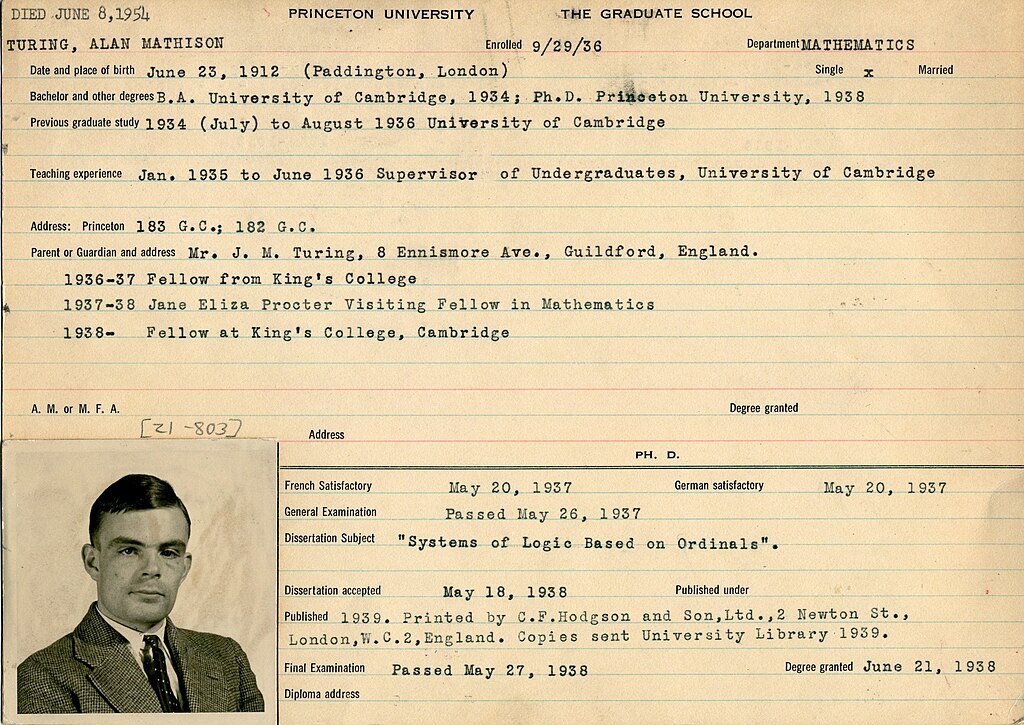

El concepto de entropía puede ser bastante confuso, en parte porque en realidad hay diferentes tipos. El matemático húngaro John von Neumann explicó la situación de esta manera: «Quien use el término ‘entropía’ en una discusión siempre gana, ya que nadie sabe qué es realmente, por lo que en un debate siempre se tiene la ventaja».

«Es un poco difícil definir la entropía», dice Popovic. «Quizás se define mejor como una propiedad termodinámica no negativa, que representa una parte de la energía de un sistema que no puede convertirse en trabajo útil. Por lo tanto, cualquier adición de energía a un sistema implica que una parte de la energía se transformará en entropía, aumentando el desorden en el sistema. Por lo tanto, la entropía es una medida del desorden de un sistema».

La definición puede variar según la disciplina que la estés tratando en ese momento:

A mediados del siglo XIX, un físico alemán llamado Rudolph Clausius, uno de los fundadores del concepto de termodinámica, estaba trabajando en un problema relacionado con la eficiencia en las máquinas de vapor e inventó el concepto de entropía para ayudar a medir la energía inútil que no se puede convertir en trabajo útil. Un par de décadas más tarde, Ludwig Boltzmann (el otro «fundador» de la entropía) utilizó el concepto para explicar el comportamiento de inmensos números de átomos: aunque es imposible describir el comportamiento de cada partícula en un vaso de agua, aún es posible predecir su comportamiento colectivo cuando se calientan usando una fórmula para la entropía.

«En la década de los sesenta, el físico estadounidense E.T. Jaynes, interpretó la entropía como información que nos falta para especificar el movimiento de todas las partículas en un sistema», dice Popovic. «Por ejemplo, un mol de gas consiste en 6 x 1023 partículas. Por lo tanto, para nosotros, es imposible describir el movimiento de cada partícula, así que en su lugar hacemos lo mejor, definiendo el gas no a través del movimiento de cada partícula, pero a través de las propiedades de todas las partículas combinadas: temperatura, presión, energía total. La información que perdemos cuando hacemos esto se conoce como entropía».

Y el aterrador concepto de «la muerte térmica del universo» no sería posible sin la entropía. Debido a que nuestro universo probablemente comenzó como una singularidad, un punto de energía ordenado infinitamente pequeño, que se expandió y continúa expandiéndose todo el tiempo, la entropía crece constantemente en nuestro universo porque hay más espacio y, por lo tanto, más estados potenciales de desorden que pueden adoptar los átomos. Los científicos han planteado la hipótesis de que, mucho después de que tú y yo nos hayamos ido, el universo finalmente alcanzará algún punto de desorden máximo, momento en el que todo tendrá la misma temperatura, sin focos de orden (como estrellas y chimpancés).

Y si esto sucede, tendremos que agradecérselo a la entropía.

Fuente: How Stuff Works – Ejemplos

Tiene un punto de consternación importante como los humanos intentamos oponernos al «caos» (o a su apariencia) de la realidad. Y lo muy difícil, y en cierto modo inútil que resulta ante el hecho de la muerte.

Fantástica información que ha agregado hasta ahora. Disfruté mucho mientras leía su artículo. Muchas gracias por postear.